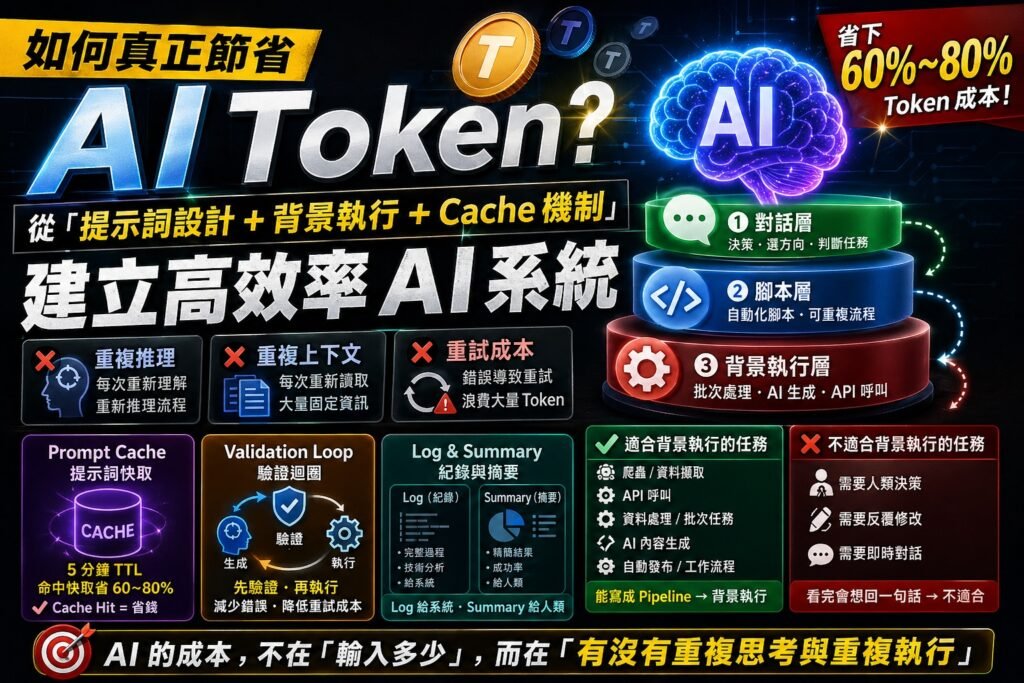

在使用 Claude Code 的過程中,整理出這些 claude code 省 token 技巧 後,實際消耗量降低約 60~80%。這些做法不是什麼高深理論,而是根據 Anthropic 官方說明和實際跑過的流程,整理出三個核心原則:減少重複推理、分離對話與執行、善用 Prompt Cache。如果你也想讓 AI 工作更有效率,這篇整理會對你有幫助。

為什麼 Token 會用這麼快?三個真正的浪費來源

大部分人以為 Token 消耗是因為「問太多問題」,但實際跑過流程後發現,真正的浪費來自這三個地方:

1. 重複推理(Repeated Reasoning)

每次開新對話,AI 都要重新理解你的任務、重新推理流程邏輯。即使是相同的任務,AI 也無法「記住」上次怎麼做,必須從頭開始分析。這個過程消耗的 Token,往往比實際執行還多。

💡 範例:讓 AI 寫一篇文章,第一次要花 3 分鐘理解需求,第二次還是要花 3 分鐘,因為 AI 不會「記得」第一次怎麼做。

2. 重複上下文(Repeated Context)

每次對話,Claude Code 都會載入:

- System Prompt(系統提示):告訴 AI 你是誰、你的角色

- 歷史對話:之前的所有問答記錄

- 規則文件:CLAUDE.md、MEMORY.md 等設定檔

這些內容通常佔據整個輸入的 60~80%,但每次都要重新讀取、重新計算 Token。

3. 重試成本(Retry Cost)

當 AI 做錯時,你必須:

- 重新說明問題

- AI 重新推理

- 重新執行任務

這個「重試循環」消耗的 Token,往往比一次正確推理還要貴 2~3 倍。

| 浪費來源 | 說明 | 佔比 |

|---|---|---|

| 重複推理 | 每次對話都要重新理解任務 | 約 20~30% |

| 重複上下文 | System Prompt、歷史、規則每次重讀 | 約 60~80% |

| 重試成本 | 做錯後重新執行的額外消耗 | 錯誤次數 × 2~3 倍 |

Prompt Cache:為什麼可以省 60~80% 的 Token?

Prompt Cache(提示詞快取)是 Anthropic 提供的功能,用來暫時儲存重複使用的固定內容,避免每次都重新計算 Token。

什麼是 Prompt Cache?

當你送出一段提示詞給 Claude 時,系統會:

- 檢查這段內容是否與上次「完全一致」

- 如果一致,直接從快取讀取(Cache Hit,命中快取)

- 如果不一致,重新計算 Token(Cache Miss,未命中快取)

💡 關鍵限制:改一個字就失效。Prompt Cache 是「完全比對」,只要內容有任何差異,快取就會失效,必須重新計算。

TTL(Time To Live):快取存活時間

根據 Anthropic 官方說明,Prompt Cache 的 TTL 約為 5 分鐘。如果超過 5 分鐘沒有使用,快取會失效,下次必須重新計算。

為什麼可以省 60~80%?

分析實際使用情況發現,AI 輸入的內容通常是:

- 60~80% 是固定上下文(System Prompt、CLAUDE.md、MEMORY.md、規則文件)

- 20~40% 是變動內容(你的問題、任務描述)

當固定上下文被快取後,這 60~80% 的部分幾乎免費,只需計算變動的 20~40%。這就是為什麼開啟 Prompt Cache 後,Token 消耗可以大幅降低。

| 術語 | 英文 | 說明 |

|---|---|---|

| 提示詞快取 | Prompt Cache | 暫時儲存重複使用的固定內容 |

| 命中快取 | Cache Hit | 內容與上次一致,直接讀取快取 |

| 未命中快取 | Cache Miss | 內容有變動,必須重新計算 |

| 存活時間 | TTL (Time To Live) | 快取有效期限,約 5 分鐘 |

Prompt Cache 的限制

- 完全比對:改一個字就失效,無法「部分快取」

- TTL 限制:超過 5 分鐘沒用就要重算

- 只解決上下文成本:無法減少推理成本和重試成本

三層 AI 系統架構:對話、腳本、背景執行

根據實際跑過的流程整理出這個三層架構,每層負責不同的任務,避免所有事情都擠在對話層消耗 Token。

第一層:對話層(Decision Layer)

這一層只做兩件事:①決策:選擇要做什麼、選哪個方向 ②指令:下達明確的執行指令。不負責實際執行、不輸出完整推理過程、不做重複的資料處理。

第二層:腳本層(Automation Layer)

把所有可重複的固定流程寫成 Python 腳本,例如:爬蟲資料抓取、API 呼叫與資料處理、批次任務執行、WordPress 文章發布、Search Console 索引提交。這些任務不需要 AI 重新推理,直接執行腳本即可。

第三層:背景執行層(Background Execution)

把耗時任務放到背景執行,不佔用對話資源。執行完成後,只回傳一個簡短摘要(Summary),不輸出完整過程。

💡 範例:NotebookLM 生成影片需要 3~5 分鐘,如果在對話中等待,會佔用大量 Token。改成背景執行後,對話立刻結束,AI 只回報「已觸發影片生成,預計 5 分鐘完成」。

| 層級 | 功能 | 範例 |

|---|---|---|

| 對話層 | 決策、選方向 | 「要發布文章還是先做 SEO 研究?」 |

| 腳本層 | 固定流程自動化 | python3 wp_api.py publish |

| 背景執行層 | 耗時任務背景跑 | NotebookLM 影片生成、大量資料爬蟲 |

Log vs Summary:人只看摘要,系統才看紀錄

在實際執行任務時,發現一個關鍵原則:大部分時候,人類不需要看完整的執行過程,只需要看結果摘要。

Log(紀錄)vs Summary(摘要)

| 類型 | 內容 | 給誰看 |

|---|---|---|

| Log | 完整執行過程、中間狀態、錯誤訊息 | 系統(除錯用) |

| Summary | 成功與否、關鍵數據、下一步建議 | 人類(快速了解) |

💡 原則:人只看 summary,不看 log。AI 在對話中只輸出 summary,完整 log 寫入檔案供系統後續查詢。這樣對話保持簡潔,每次推理更快、更省 Token。

哪些任務適合背景執行?判斷標準很簡單

✅ 適合背景執行

- 爬蟲:抓取大量資料,不需要即時互動

- API 呼叫:呼叫外部服務,等待回應時間較長

- 資料處理:清洗、轉換、分析大量資料

- AI 內容生成:NotebookLM 影片、FLUX 圖片生成

- 批次任務:批次發布文章、批次提交索引

- 自動發布:WordPress、Facebook、YouTube 上傳

❌ 不適合背景執行

- 需要人決策:選題、選關鍵字、確認方向

- 需要反覆修改:文章撰寫、程式碼開發

- 需要即時對話:問答、討論、腦力激盪

💡 判斷標準:「看完結果還會想再回一句話」→ 不要背景化。如果看完結果就結束,沒有後續討論,就適合背景執行。

Validation Loop:用推理成本換重試成本

Validation Loop(驗證迴圈)是一個簡單但有效的機制,用來減少錯誤重試的成本。

兩種流程對比

| 流程 | 步驟 | Token 消耗 |

|---|---|---|

| ❌ 無驗證 | 生成→執行→錯誤→重新生成→執行 | 約 6000 Token |

| ✅ 有驗證 | 生成→驗證→修正→驗證→執行 | 約 3900 Token |

💡 核心邏輯:用「前期推理成本」換「後期重試成本」。在執行前多花一點 Token 驗證,可以避免執行後發現錯誤、重新推理、重新執行的高成本循環。

推理成本 vs 錯誤成本:找到最佳平衡點

很多人以為「減少推理」就能省 Token,但實際情況是:推理太少會導致錯誤增加,錯誤重試的成本往往更高。

AI 系統最佳狀態

根據整理的經驗,AI 系統的最佳狀態是:

- 適量推理:不要過度推理,但也不能太少

- Validation Loop:用驗證機制降低錯誤率

- Prompt Cache:快取固定上下文,減少重複計算

| 策略 | 推理成本 | 錯誤率 | 總成本 |

|---|---|---|---|

| 推理太少 | 3000 Token | 高 | 約 9000 Token |

| 適量推理+驗證 | 4000 Token | 低 | 約 5000 Token ✅ |

| 過度推理 | 6000 Token | 極低 | 約 6500 Token |

實際可用的 Prompt 模板(可複製)

根據前面整理的原則,這裡提供一個實際可用的 Prompt 模板,可以直接套用到 Claude Code 的 System Prompt 或任務指令中。

常見問題 FAQ

Q1: claude code 省 token 技巧中,Prompt Cache 為什麼有時候不起作用?

Prompt Cache 有三個主要限制:①內容必須「完全一致」,改一個字就失效 ②TTL 約 5 分鐘,超過時間就要重算 ③只快取固定上下文,無法快取變動內容。如果你發現 Cache 沒作用,檢查是不是因為 System Prompt 或規則文件被修改了,或是間隔時間超過 5 分鐘。

Q2: 背景執行適合哪些 claude code 省 token 的場景?

適合的場景包括:爬蟲、API 呼叫、資料處理、AI 內容生成(NotebookLM、FLUX)、批次任務、自動發布。判斷標準是「看完結果就結束,不需要後續對話」。如果看完結果還想討論或修改,就不適合背景執行。

Q3: Validation Loop 會不會反而增加 token 消耗?

Validation 確實會增加前期推理成本,但可以大幅降低錯誤重試成本。用 200~500 Token 做驗證,可以避免 3000~6000 Token 的重試成本,整體是划算的。

Q4: Log 和 Summary 分離後,如何查詢完整執行記錄?

Log 應該寫入檔案(例如 執行報告.md 或 task_log.json),需要查詢時直接讀檔案即可。對話中只顯示 Summary,保持簡潔。

Q5: 三層架構中,對話層應該負責什麼?

對話層只負責兩件事:①決策(選擇要做什麼、選方向)②下達指令。不負責實際執行、不輸出完整推理過程、不做重複的資料處理。把執行層的工作交給腳本層和背景執行層,可以大幅降低對話中的 Token 消耗。

延伸閱讀

古焌宥|雲林 AI 老師,專注於 Claude Code 應用整理與 AI 自動化流程設計。擅長將複雜的 AI 技術轉化為實用的工作流程,幫助更多人善用 AI 工具提升效率。

解壓縮 → 拖入 Claude Code → 輸入任意一句話,5 分鐘完成安裝

✅ EvoForge 核心功能:

🧠 三層記憶系統,50 Token 完成查詢(關掉不再忘記)

🔗 85-Token 跨對話橋接,任務中斷秒速恢復不重頭來

⚡ DCI 動態 Context 注入,省 70%+ Token

📈 Stop Hook 自動進化,同類任務 3 次自動腳本化

🛠️ 12 個核心技能,/斜線指令開箱即用

🤖 3 個子代理協作,不消耗主對話 Token

原價 NT$1,288

NT$600

前 100 名優惠 · 買斷不收月費 · MIT 授權可自由修改

Mac & Windows 適用 · 確認匯款後立即出貨 · LINE:kenemail2